こないだ試してみた、ChatGPT ですが、友人が「読むべき本を教えてもらったら、へんてこな結果が出た」と教えてくれたので、僕もやってみました。

「ローマ帝国について知りたいのですが、どんな本を読めばいいですか?」とChatGPTに質問をしてみました。

5冊の本を教えてくれました。「お、すごい」と思っていましたが、内容を詳細に見ていくと、最初のEdward Gibbon(エドワード・ギボン)は、『ローマ帝国衰亡史』を書いた人です。検索してみると、『ローマ史』という本は見つかりません。惜しいけども。

2番目のPeter Heather(ピーター・ヘザー)も、『The Fall of the Roman Empire: A New History of Rome and the Barbarians(ローマ帝国の没落:ローマと異民族の新しい歴史)』を書いた人です(翻訳されていないっぽい)。検索してみても、『ローマ帝国』という著書は見当たりませんでした。

その下に並んでいる、Michael Grant(マイケル・グラント)もTheodor Mommsen(テオドール・モムゼン)もFergus Millar(ファーガス・ミラー)も、みんな実在してローマ帝国を研究している人たちですが、ここに挙げられているタイトルの本を出してはいません。

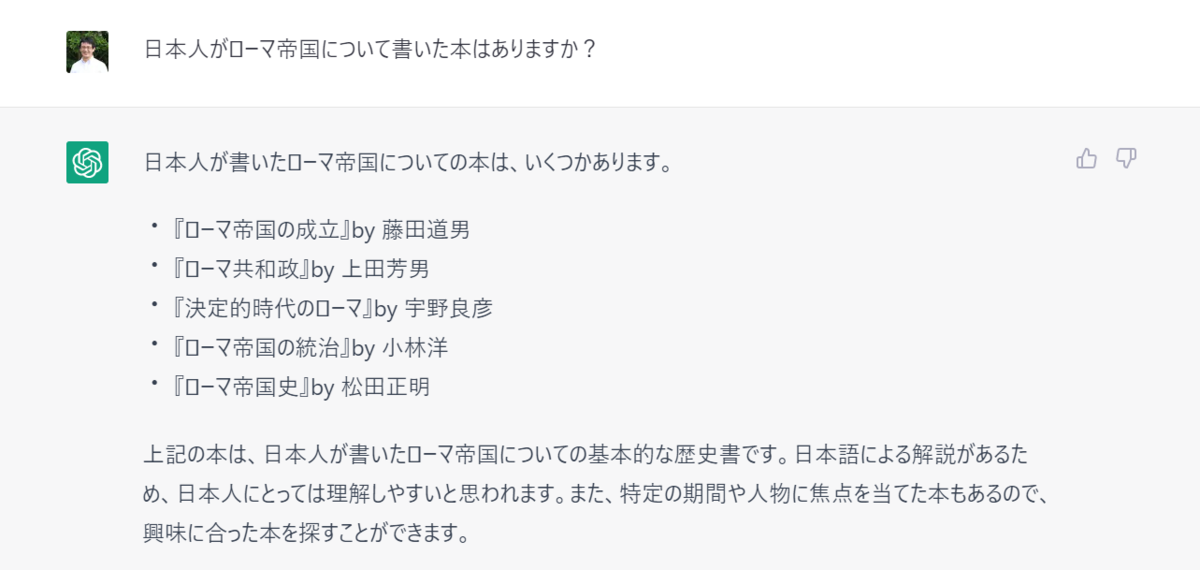

日本人が書いた研究書が出てこないかなと思って、さらに質問してみました。今回も5冊の本が紹介されました。

こちらでも結果は同じで、書名で検索をかけても出てこないようです。レポートでChatGPTを使って参考文献とかさらりと出したい学生の皆さん、危険です(笑)

こうした「一見それっぽく見えるけれど、実は正しくない」情報は、「明らかに間違っている」情報よりもずっと危険だと思います。「明らかに間違っている」情報は、誰もが「これは違う」と判断するので大変な誤解や失敗に繋がることは少ないと思いますが、「一見それっぽく見えるけれど、実は正しくない」情報は、誤りと気づかれずに採用されたり失敗に繋がる可能性も大きいと思います。

もちろん、ChatGPTをはじめ、AIテクノロジーは進歩していくので改善される欠点も多くあると思うのですが、「一見それっぽく見えるけれど、実は正しくない」情報があるのだ、ということを知っておくことは重要だと思いました。

(為田)